在当前的AI应用开发浪潮中,很多从传统Web转型AI的开发者(包括曾经的我)容易陷入一个误区:认为只要调通了LLM的API,把文本渲染到页面上,工作就完成了。然而,在实际的商业落地场景中,用户对于交互的掌控感有着极高的要求。

试想一下,当用户发现提问有误,或者AI开始“胡说八道”时,如果必须等待它慢吞吞地输出完几百个字才能进行下一步操作,这种体验是灾难性的。今天我们就来聊聊如何通过“停止生成”与“重新回答”这两个看似简单的功能,精准捕捉用户意图,提升AI产品的交互质感。

一、背景与痛点:流式传输下的“失控感”

在传统的HTTP请求中,前端发送请求,等待响应,是一次性的“原子操作”。但在AI对话中,为了追求类似ChatGPT的打字机效果,我们普遍采用了Server-Sent Events (SSE) 或 WebSocket Stream 模式。

这种流式传输带来了两个显著的痛点:

- 资源浪费与不可控性:一旦请求发出,后端就开始疯狂计算Token。如果用户发现问错了问题,无法中断,不仅浪费了宝贵的API额度,还占用了连接资源。

- 上下文状态管理的复杂性:实现“重新回答”不仅仅是重新发一次请求。如果用户在AI回答过程中点击了“停止”,此时会话历史应该如何存储?是存储半截回答,还是完全回滚?这涉及到前端状态机与后端Context的同步问题。

如果无法解决这些问题,用户就会产生一种“失控感”,这对于产品的商业留存是致命的。

二、核心内容讲解:中断机制与状态回滚

要实现这两个功能,核心在于理解前端控制流与后端数据流的协同。

1. “停止生成”的实现原理

在Web开发中,标准的HTTP请求可以通过AbortController接口来中断。在流式请求中,原理相同,但需要处理流读取器的释放。

- 前端动作:调用controller.abort(),切断网络连接。

- 状态处理:前端需要标记当前会话状态为stopped,保留已生成的文本片段,但不再继续追加。

- 后端反应:连接断开,后端流式接口会捕获到连接中断异常,从而停止后续的Token生成计算。

2. “重新回答”的逻辑闭环

“重新回答”本质上是一次状态回滚。

- UI层面:用户点击重试,意味着上一次的AI回答作废。

- 数据层面:在发送新请求前,必须从会话历史数组中移除最后一条AI的回复记录。

- 参数微调:为了保证生成结果的差异性,通常在重新请求时,可以在后端微调temperature参数或添加随机种子,避免AI生成完全相同的内容。

三、实战代码与案例

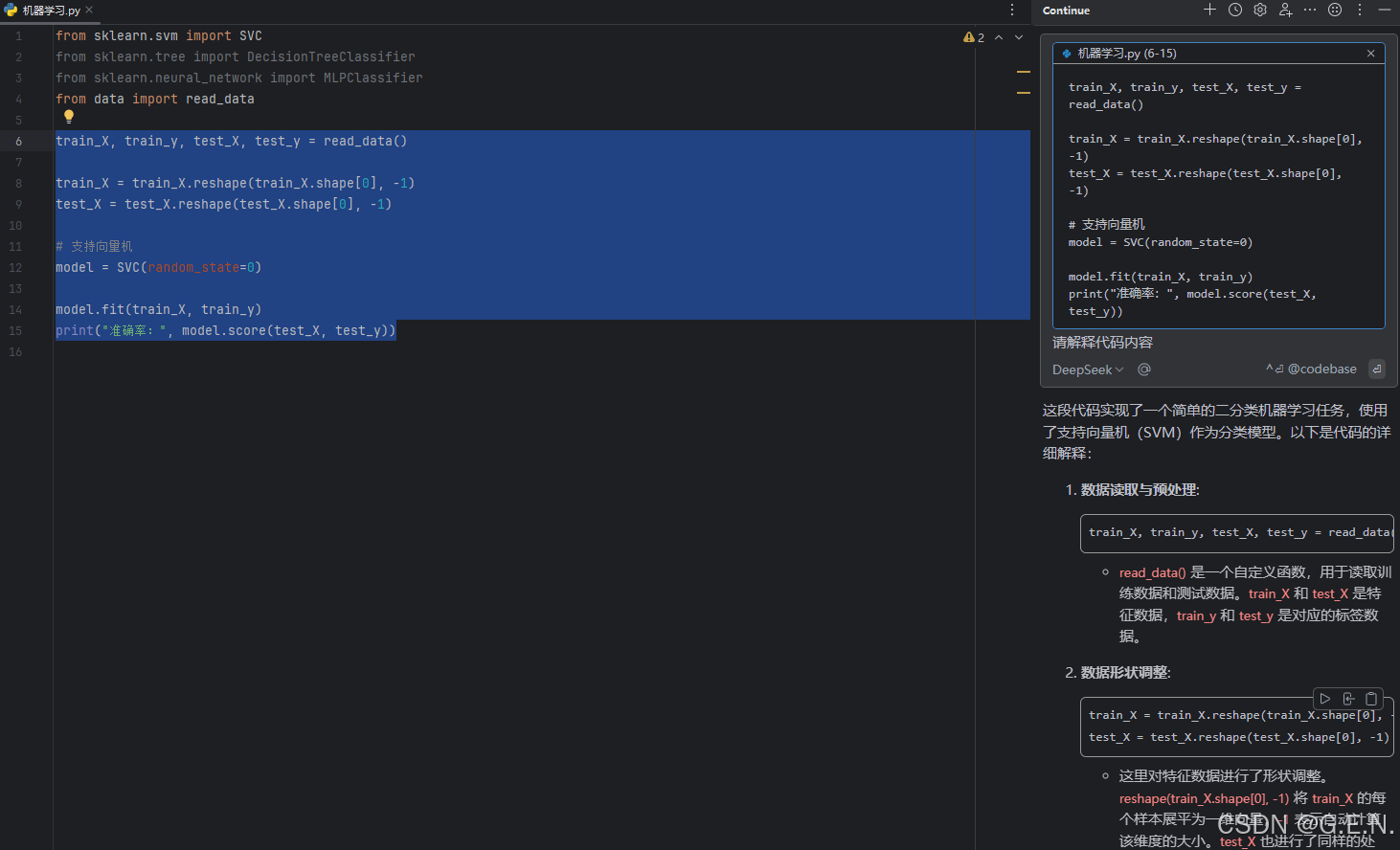

为了更清晰地演示,我们以前端 TypeScript (React技术栈) 和后端 Python (FastAPI) 为例,构建一个最小可行性案例。

1. 前端实现:停止与重试逻辑

这是核心的交互逻辑层。我们需要维护一个messages列表和一个abortController实例。

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95 96 97 98 99 100 101 102 103 104 105 106 107 108 109 |

import React, { useState, useRef } from 'react';

// 定义消息结构 interface Message { id: string; role: 'user' | 'assistant'; content: string; status?: 'complete' | 'stopped'; // 标记消息状态 }

const ChatComponent: React.FC = () => { const [messages, setMessages] = useState<Message[]>([]); const [input, setInput] = useState(''); // 用于中断请求的控制器 const abortControllerRef = useRef<AbortController | null>(null); const [isGenerating, setIsGenerating] = useState(false);

// 发送消息的核心逻辑 const handleSend = async () => { if (!input.trim() || isGenerating) return;

const userMessage: Message = { id: Date.now().toString(), role: 'user', content: input }; // 初始化AI回复占位符 const aiMessage: Message = { id: (Date.now() + 1).toString(), role: 'assistant', content: '', status: 'complete' };

// 更新本地状态 setMessages(prev => [...prev, userMessage, aiMessage]); setInput(''); setIsGenerating(true);

// 创建新的 AbortController abortControllerRef.current = new AbortController();

try { // 模拟流式请求 (实际项目中替换为 fetch SSE 接口) const response = await fetch('/api/chat', { method: 'POST', body: JSON.stringify({ prompt: input }), signal: abortControllerRef.current.signal, // 关键:绑定中断信号 headers: { 'Content-Type': 'application/json' } });

// 模拟流式读取 const reader = response.body?.getReader(); // ... 此处省略具体的流式解码逻辑,重点在于数据追加 ...

} catch (error: any) { if (error.name === 'AbortError') { console.log('用户主动停止了生成'); // 更新最后一条消息的状态为 stopped setMessages(prev => { const newMsgs = [...prev]; const lastMsg = newMsgs[newMsgs.length - 1]; if (lastMsg.role === 'assistant') lastMsg.status = 'stopped'; return newMsgs; }); } } finally { setIsGenerating(false); abortControllerRef.current = null; } };

// 【核心功能1】停止生成 const handleStop = () => { if (abortControllerRef.current) { abortControllerRef.current.abort(); // 触发中断 } };

// 【核心功能2】重新回答 const handleRetry = async (retryIndex: number) => { // 1. 找到对应的用户提问 (当前索引-1) const userPrompt = messages[retryIndex - 1].content;

// 2. 状态回滚:移除当前AI回答及之后的对话 (防止上下文污染) // 注意:这里保留用户提问,只移除AI回答,也可以根据业务需求移除两者 setMessages(prev => prev.slice(0, retryIndex));

// 3. 重新触发发送逻辑 (这里简化处理,实际应复用 handleSend 逻辑) // 实际开发中建议封装一个 receiveStream(prompt) 方法供调用 console.log(`Retrying with prompt: ${userPrompt}`); // await handleSendInternal(userPrompt); };

return ( <div className="chat-container"> {/* 渲染消息列表 */} {messages.map((msg, index) => ( <div key={msg.id} className={`message ${msg.role}`}> {msg.content} {msg.status === 'stopped' && <span className="tag"> (已停止)</span>} {msg.role === 'assistant' && ( <button onClick={() => handleRetry(index)}>重新生成</button> )} </div> ))}

{/* 底部操作栏 */} <div className="input-area"> {isGenerating ? ( <button onClick={handleStop}>停止生成</button> ) : ( <button onClick={handleSend}>发送</button> )} </div> </div> ); }; |

2. 后端视角:FastAPI的中断检测

后端不仅仅是被动接收,最好能感知前端断开,以停止GPU计算。FastAPI中可以通过检查request.is_disconnected()来实现。

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 |

from fastapi import FastAPI, Request from fastapi.responses import StreamingResponse import asyncio

app = FastAPI()

async def generate_stream(prompt: str, request: Request): # 模拟LLM生成的token流 words = ["你好", ",", "我是", "AI", "助手", "。"] for word in words: # 【关键点】检测客户端是否断开连接 if await request.is_disconnected(): print("客户端已断开,停止生成") break

# 模拟生成延迟 await asyncio.sleep(0.5) yield f"data: {word}\n\n"

@app.post("/api/chat") async def chat(request: Request): data = await request.json() prompt = data.get("prompt") return StreamingResponse( generate_stream(prompt, request), media_type="text/event-stream" ) |

代码解析:

* 前端通过AbortController实现了对网络连接的物理切断。

* 后端通过request.is_disconnected()实现了计算逻辑的软停止,这对于节省服务器算力成本至关重要。

* handleRetry函数展示了最核心的“回滚”逻辑:在重试前,必须清理掉历史记录中无效的AI回复,否则下次请求会把错误的上下文发给模型。

四、总结与思考

在AI应用开发中,我们往往沉迷于Prompt的调优和RAG架构的设计,却忽视了交互层面的工程细节。实现“停止”与“重试”看似是前端的小功能,实则是对Web应用状态管理能力的考验。

从商业价值角度看,这两个功能直接关联成本与体验:

1. 成本控制:及时停止无效请求,直接节省了Token消耗,在高并发场景下是一笔可观的成本节约。

2. 用户体验:给予用户“后悔药”和“控制权”,是产品从“能用”走向“好用”的关键一步。

对于正在转型AI开发的工程师来说,这给我们一个启示:LLM应用不仅仅是算法的堆叠,更是传统Web工程能力在流式数据场景下的延伸与重构。只有将扎实的工程底座与AI能力结合,才能构建出真正具备商业竞争力的产品。