Claude Code接入本地大模型Qwen3.6 进行代码开发(vLLM 部署 + 环境配置)

Claude Code 是 Anthropic 推出的智能编码命令行工具,默认使用 Claude 系列模型。但我们可以通过指定自定义 API 端点,将其连接到本地部署的 Qwen3.6 模型,实现本地模型 + 强大编码助手的组合。 本

|

Claude Code 是 Anthropic 推出的智能编码命令行工具,默认使用 Claude 系列模型。但我们可以通过指定自定义 API 端点,将其连接到本地部署的 Qwen3.6 模型,实现“本地模型 + 强大编码助手”的组合。 本文将带你完成: 一、环境准备与模型部署1.1 安装 Docker请确保你的系统已安装 Docker 并支持 GPU(NVIDIA Container Toolkit)。 1.2 创建 docker-compose.yml在合适的位置创建项目目录,例如 ~/vllm-qwen,并在其中新建 docker-compose.yml 文件,内容如下:

1.3 启动模型服务在 docker-compose.yml 所在目录执行:

服务启动后会监听本机 8000 端口。 1.4 验证部署使用 curl 检查模型列表:

正常返回应包含 Qwen3.6-35B-A3B-FP8。 二、安装 Claude CodeClaude Code 支持多种安装方式,可根据你的系统选择。 2.1 通过官方脚本安装(推荐)macOS / Linux / WSL(Linux 子系统)

安装完成后重启终端或执行 source ~/.bashrc(或 ~/.zshrc)。 Windows PowerShell(管理员模式运行)

Windows CMD(命令提示符)

2.2 通过 npm 安装(适用于已安装 Node.js 的用户)

安装后,执行一次初始化(非必须,但建议):

三、配置 Claude Code 使用本地 Qwen3.63.1 设置环境变量将 Claude Code 指向本地 vLLM 服务。当前服务运行在 127.0.0.1:8000,如果其他机器使用可以ifconfig查看服务器的ip地址,认证 Token 可随意设置(vLLM 默认不校验,但需要占位符)。 Linux / macOS / WSL (bash/zsh)

若想永久生效,可将这两行追加到 ~/.bashrc 或 ~/.zshrc。 Windows PowerShell

Windows CMD

3.2 指定模型启动 Claude Code环境变量设置完毕后,使用 --model 参数指定模型名称(必须与 vLLM 启动参数 --served-model-name 一致):

首次运行会提示登录,由于我们使用的是自定义端点,可以随意输入邮箱或直接回车跳过。 启动成功后,你将看到类似如下的交互界面:

|

您可能感兴趣的文章 :

-

Claude Code接入本地大模型Qwen3.6 进行代码开发(vL

Claude Code 是 Anthropic 推出的智能编码命令行工具,默认使用 Claude 系列模型。但我们可以通过指定自定义 API 端点,将其连接到本地部署的 -

在Windows上优雅地启动Hermes Agent Web Dashboard

Hermes Agent 是 Nous Research 开发的 AI 智能体,可以在 WSL2 中运行并提供 Web Dashboard 界面。但每次启动都需要打开 WSL2 终端,运行命令,然后手动 -

一篇带你搞定Ollama模型的安装到生产级调优

一、Ollama 概述与核心价值 Ollama 是一个轻量级、可扩展的本地大语言模型运行框架,旨在简化 LLM 的部署、管理和使用流程。它将复杂的模型 -

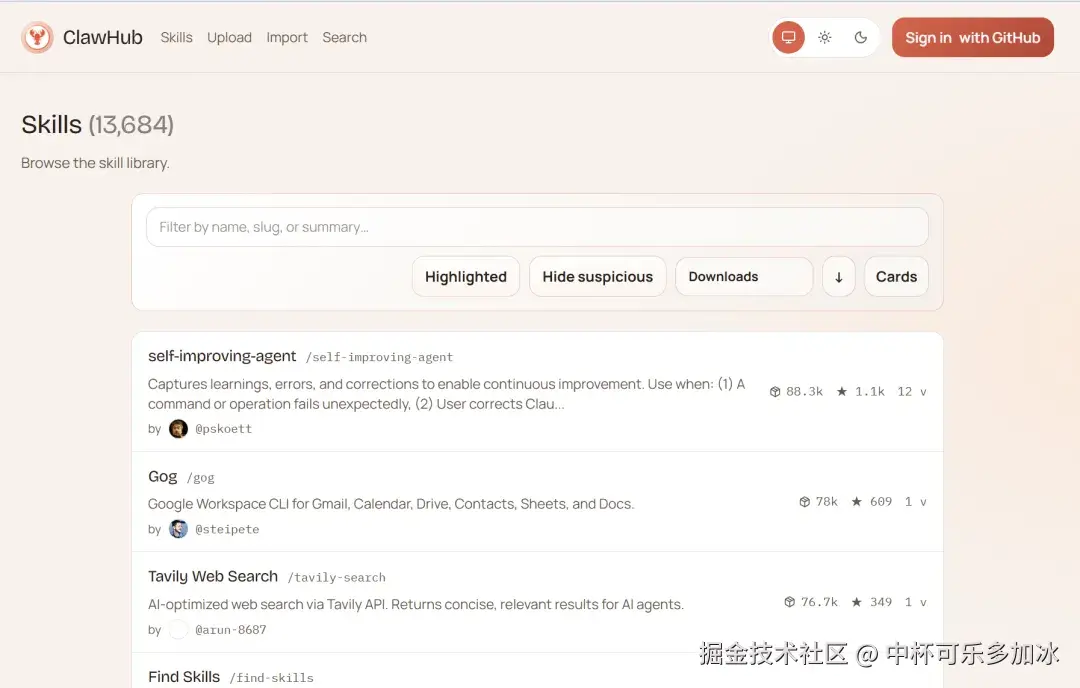

penClaw到底能做什么?有什么用?推荐你先装这几

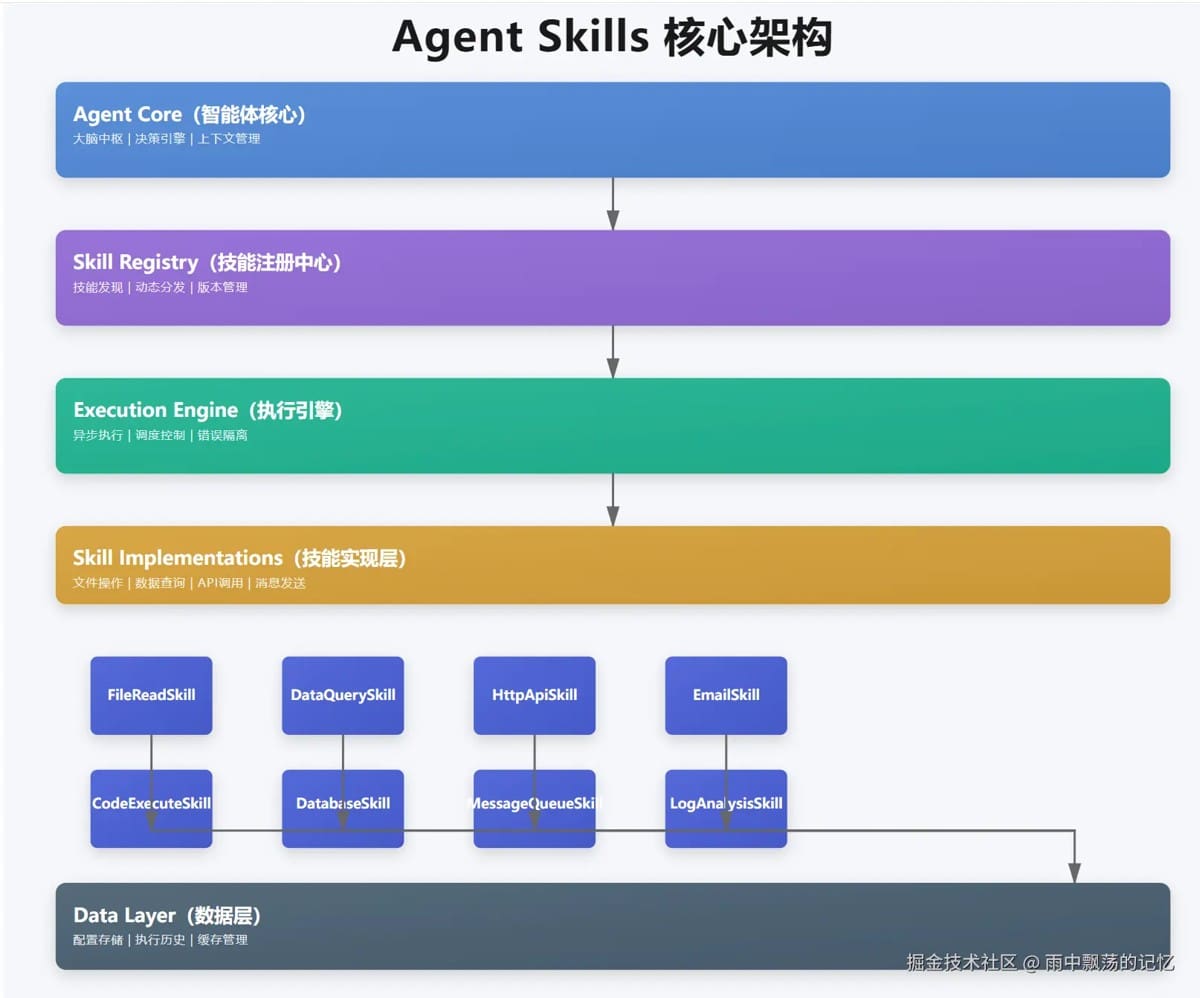

OpenClaw之所以能从众多AI助手中脱颖而出,核心原因在于它的Skills生态系统。如果说大语言模型是OpenClaw的大脑,那么Skills就是它的双手和专 -

macOS系统下安装与配置Hermes Agent的完整教程

Hermes Agent 支持 macOS,但安装过程有几个点需要注意。本文是 macOS 专属安装指南,覆盖从零配置到运行的全流程,以 MiniMax 为例演示 AI 提供 -

Hermes Agent接入DeepSeek V4的完整介绍

一、背景:为什么要在 Hermes Agent 中用 DeepSeek V4 1.1 Hermes Agent 是模型无关的 Hermes Agent 设计了一个很重要的特性模型无关(Model-Agnostic)。它 -

Windows原生部署OpenClaw并对接DeepSeek-V4大模型的全流

一、准备工作 1. 系统与环境要求 操作系统:Windows 10 21H2 及以上 / Windows 11 硬件:内存 4GB(推荐 8GB+),硬盘可用空间 1GB 网络:需联网下载 -

国内直连、低成本调用主流大模型API:以OpenCla

目前市面上提供 API 代理的平台很多,但在高并发场景下往往容易出现报错或断连问题。加上近期开源生态频繁发生的依赖包投毒事件,给

-

Agent Skills工作流从入门到实战

2026-05-11

-

OpenClaw指令分类详解与使用

2026-05-11

-

penClaw到底能做什么?有什么用?推荐

2026-05-11

-

Windows原生部署OpenClaw并对接DeepSeek-V

2026-05-11

-

在Windows上优雅地启动Hermes Agent Web D

2026-05-13